背景:

借助 LiteLLM 实现精细化额度与权限管理,解决 API缺乏约束的调用导致成本失控

安装LiteLLM

拉取LiteLLM镜像

docker pull docker.litellm.ai/berriai/litellm:main-latest |

编辑配置文件config.yaml

# 数据库配置(PostgreSQL) |

直接启动并查看日志

docker run -v $(pwd)/config.yaml:/app/config.yaml -p 4000:4000 docker.litellm.ai/berriai/litellm:main-latest --config /app/config.yaml --detailed_debug |

后台启动

docker run -d -v $(pwd)/config.yaml:/app/config.yaml -p 4000:4000 docker.litellm.ai/berriai/litellm:main-latest --config /app/config.yaml |

虚拟密钥

如需虚拟密钥功能,需先启动数据库,再启动LiteLLM

docker run -d --name litellm-db -e POSTGRES_USER=litellm -e POSTGRES_PASSWORD=litellm123 -e POSTGRES_DB=litellm -p 5432:5432 -v litellm_data:/var/lib/postgresql/data postgres:15-alpine |

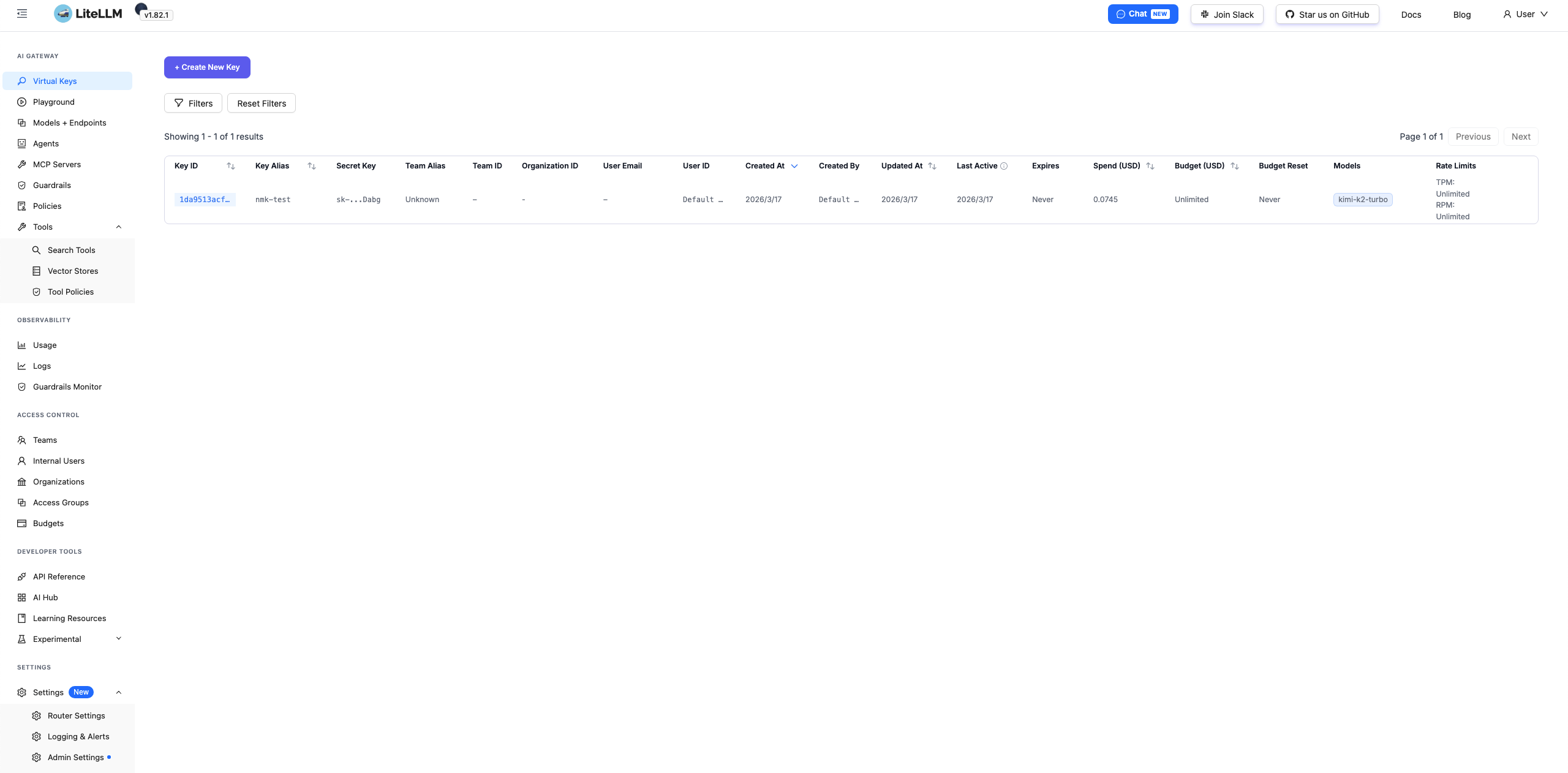

访问http://LiteLLMIP:4000/UI,即可打开LiteLLM的UI页面

使用admim+master_key进行登陆

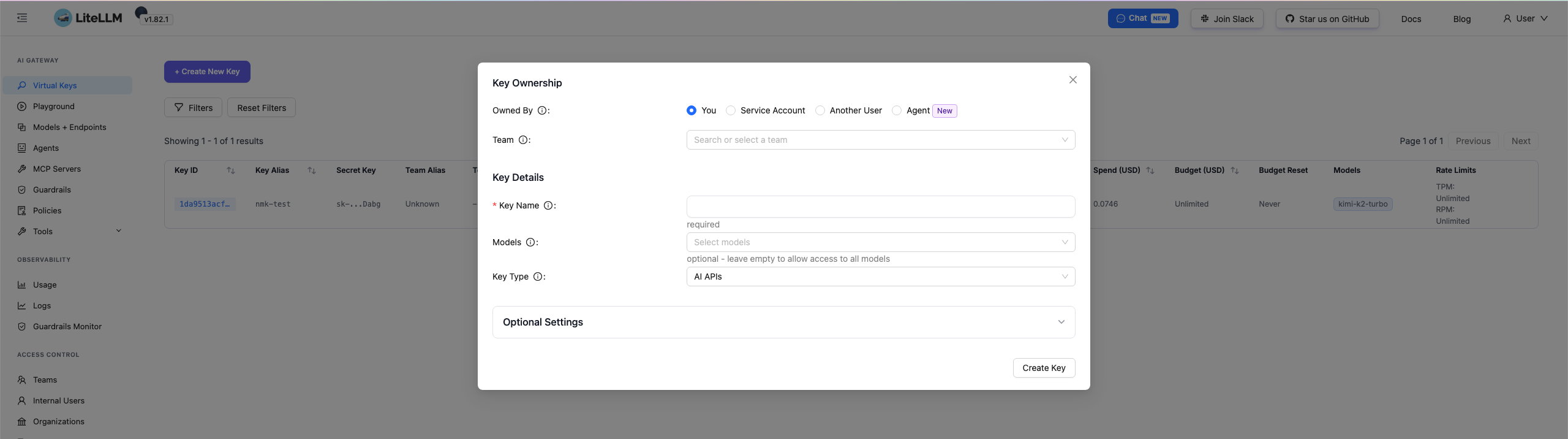

创建虚拟密钥

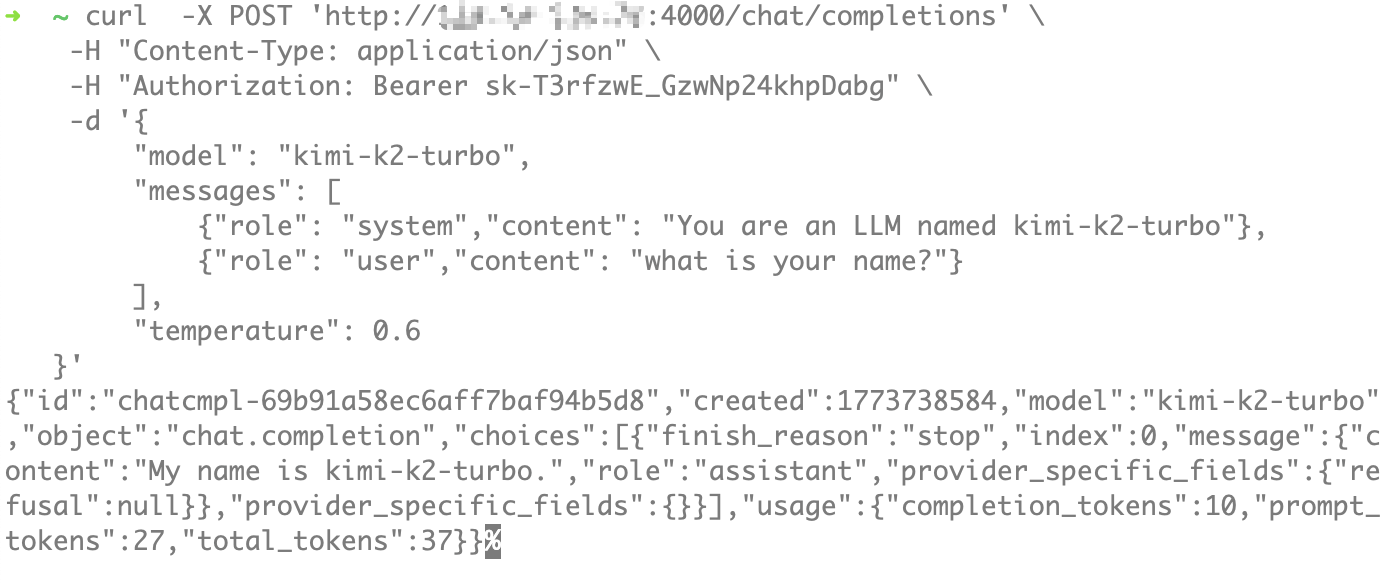

通过虚拟密钥进行请求LiteLLM,返回正常

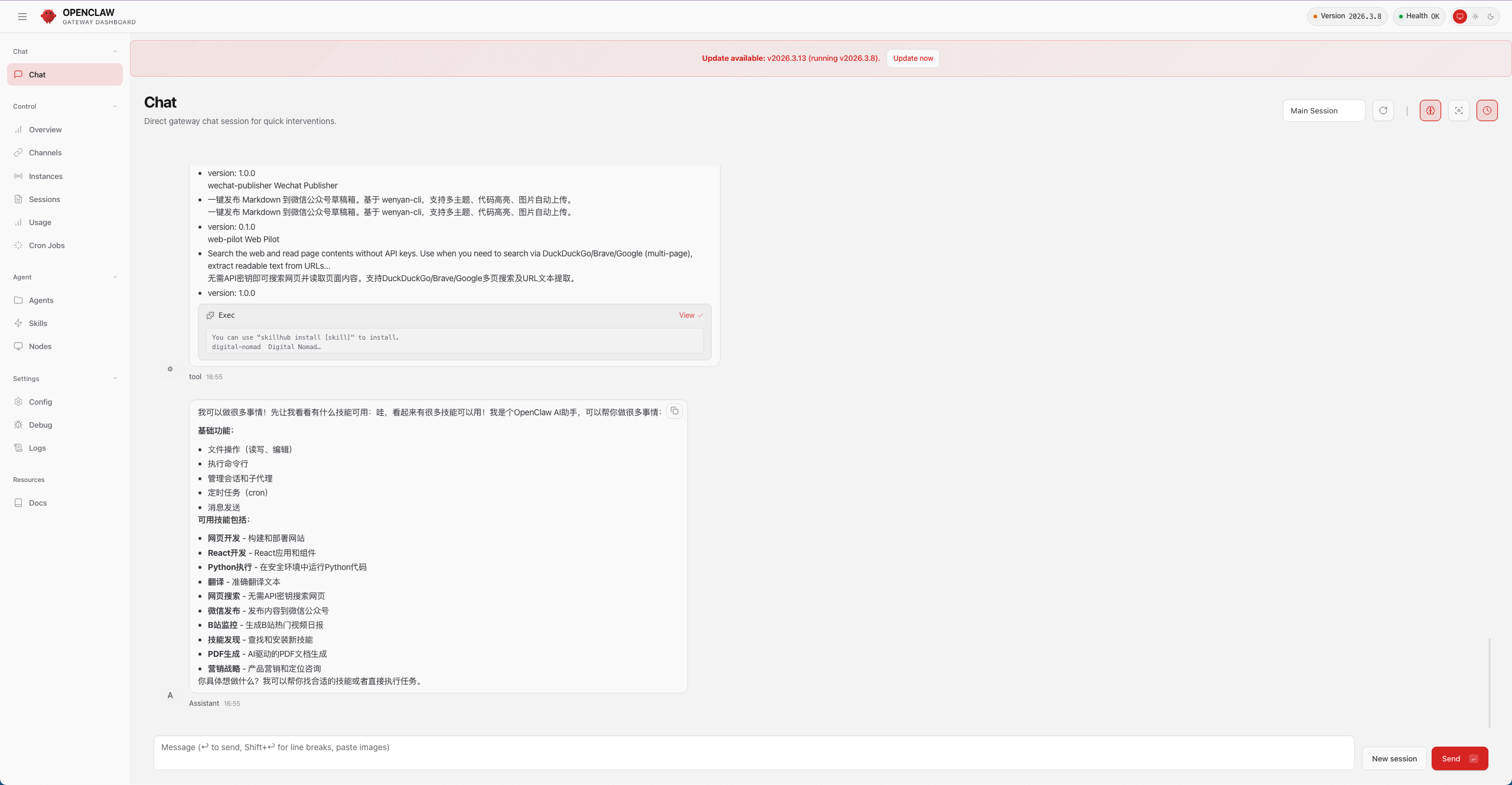

接入OpenClaw

编辑OpenClaw配置文件

vi ~/.openclaw/openclaw.json

"models": { |

重启OpenClaw

openclaw gateway restart |

进入OpenClaw,与模型对话

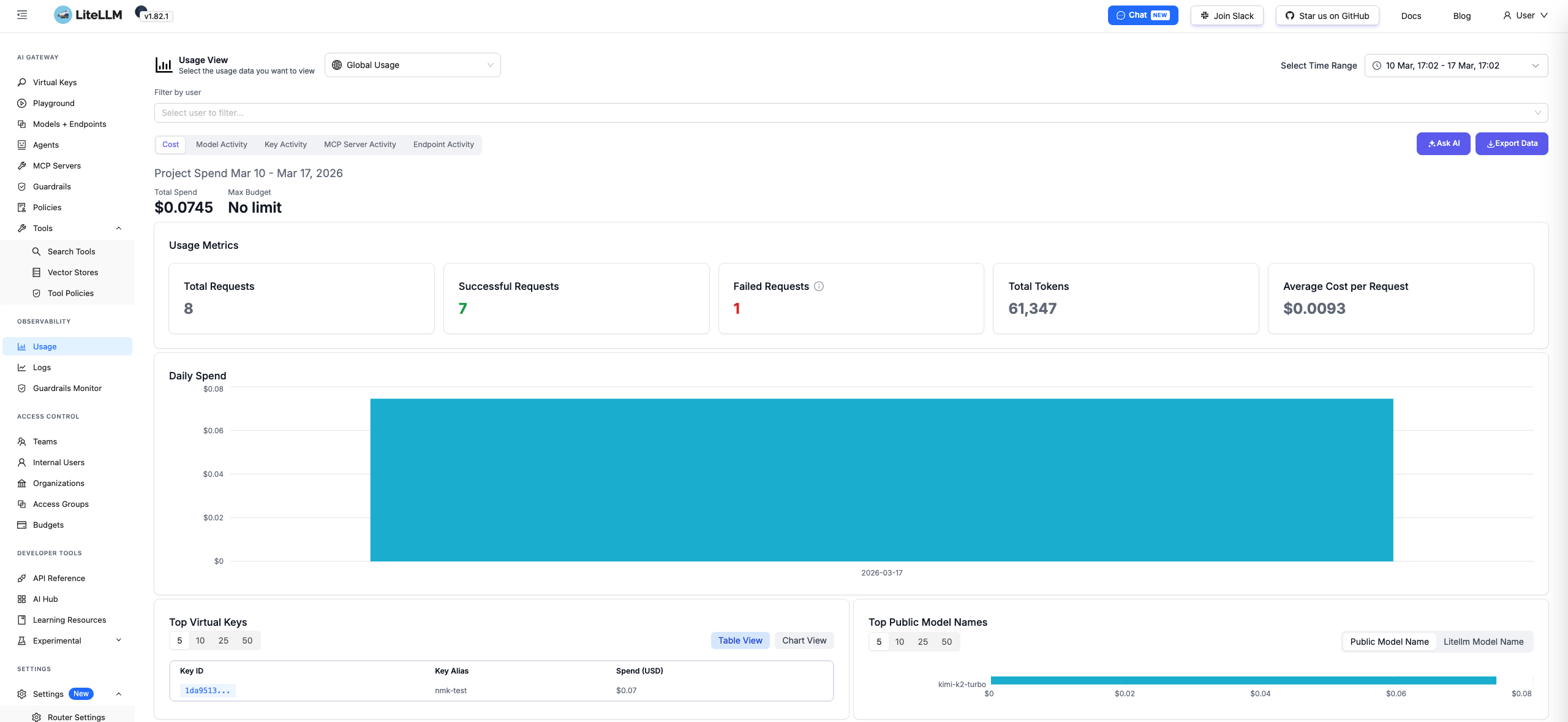

监控token使用

查看Token的使用量

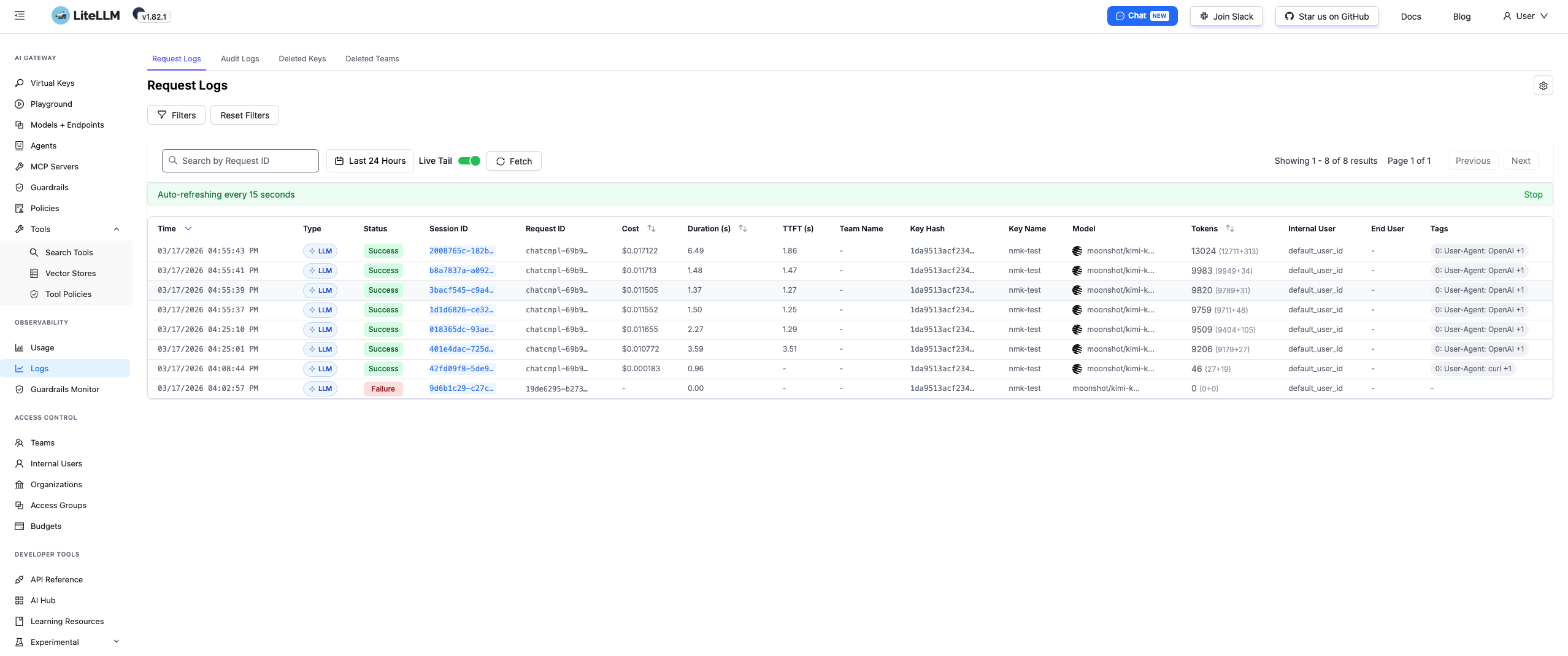

查看请求日志

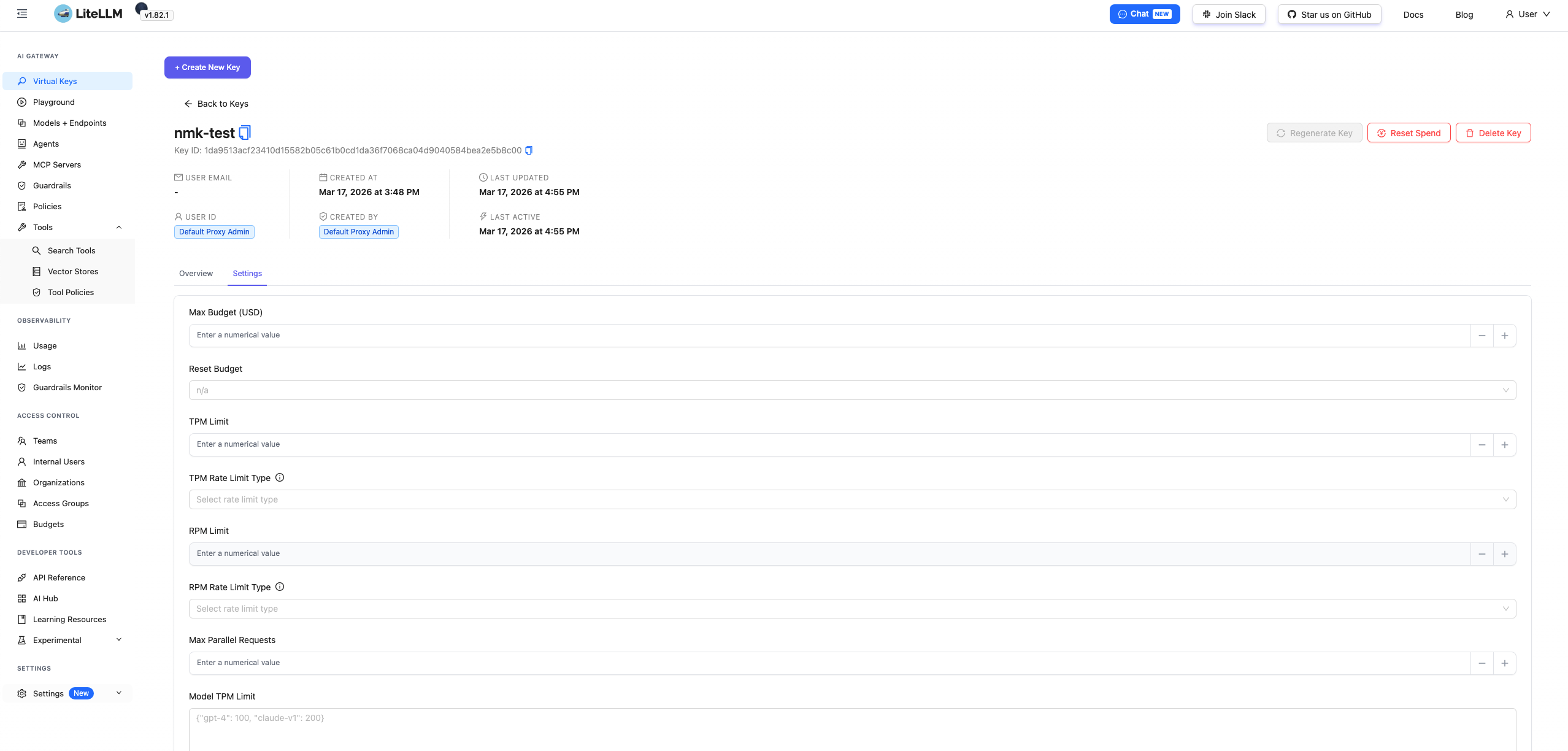

可对虚拟密钥进行限制用量和金额

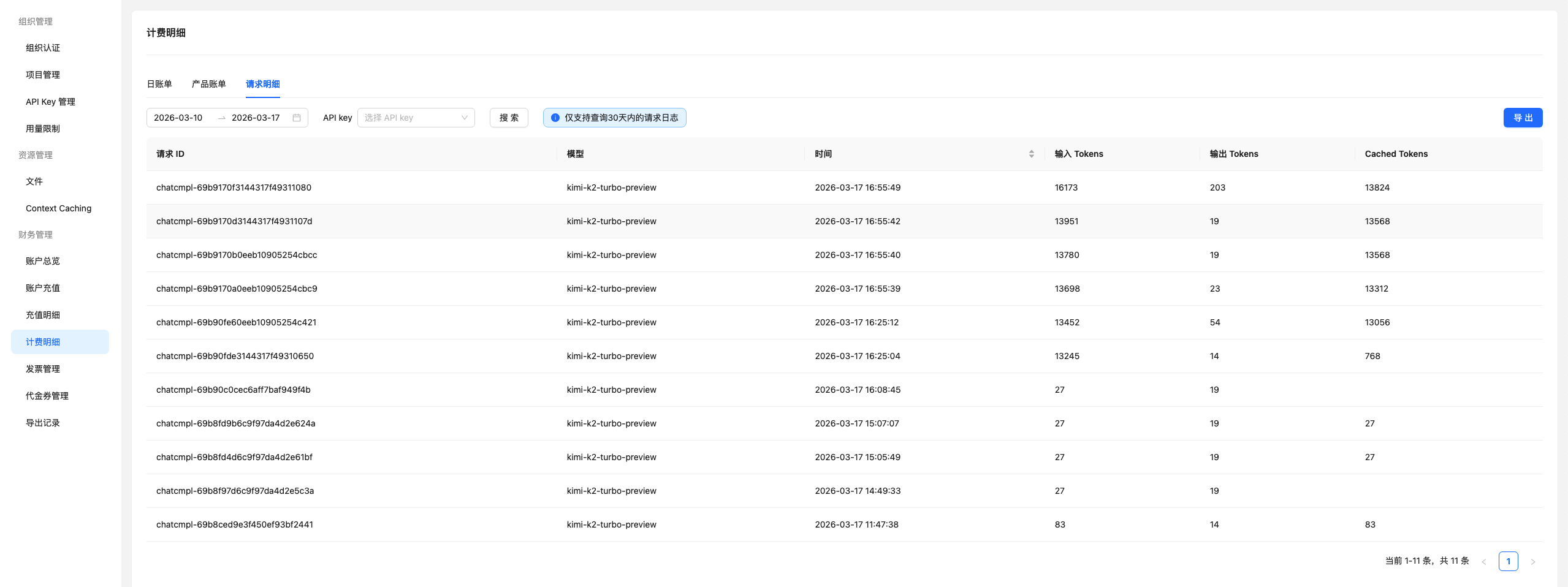

在Kimi开发者后台可查看对应的token和费用

参考文档:

https://docs.litellm.com.cn/docs/proxy/docker_quick_start

https://segmentfault.com/a/1190000047643639